Anfang der Woche veröffentlichte Facebook’s Vice President für Global Policy Management Monica Bickert ein Richtlinien-Update, das eine härtere Linie im Umgang mit manipulierten, irreführenden Media-Inhalten versprechen will.

Tagtäglich werden auf Facebook Millionen von Fotos und Videos veröffentlicht. Dass Inhalte im weitesten Sinne auch gerne mal “manipuliert” werden, also beispielsweise mit einem Filter versehen werden, der Ton angepasst oder das Video schärfer gemacht wird (ja, das alles ist bereits als Manipulation des bestehenden Materials zu verstehen), gehört inzwischen der Normalität an, sofern die Intentionen positiver Natur sind und den Wahrheitsgehalt einer Medienbotschaft nicht verfälschen. Leider gibt es jedoch auch diejenigen Contentproduzenten, die gezielt Inhalte verändern, um in die Irre zu führen, Fehlinformationen zu verbreiten, um mutwillig Schaden anzurichten (Stichwort Wahlkampf).

Manipulationen können durch einfache Programme wie Photoshop oder durch ausgeklügelte Tools und Apps vorgenommen werden, die sich wiederum künstlicher Intelligenz oder “deep learning”-Techniken bedienen, um Videos zu erstellen, die die Realität verzerren. Diese Art von Videos werden üblicherweise “Deep Fakes” genannt. Obwohl Deep Fakes im Internet noch eher selten sind, stellen sie zunehmend eine große Herausforderung für Industrie und Gesellschaft dar.

Facebook will sich proaktiv dagegen wappnen und hat im Zuge des Richtlinien-Updates in Zusammenarbeit mit über 50 Experten aus IT, Politik, Medien, Recht und Wissenschaft Kriterien entwickelt, die bei der Identifizierung und im Umgang mit den sogenannten Deep Fakes in Erwägung gezogen werden. In Zukunft werden verfälschte Videobeiträge entfernt, wenn sie die folgenden Kriterien erfüllen:

Diese Richtlinie erstreckt sich nicht auf Inhalte, die Parodie oder Satire sind, oder auf Videos, in denen lediglich O-Töne herausgestrichen oder für eine veränderte Reihenfolge umgeschnitten wurden.

Unverändert bleibt, dass bei einem Verstoss gegen unsere bestehenden Richtlinien Audio, Fotos oder Videos von Facebook entfernt werden, egal ob es sich dabei um ein Deep Fake handelt oder nicht. Sofern sie gegen einen der anderen Gemeinschaftsstandards verstoßen, einschließlich derer, die Nacktheit, Gewalt, Wählerunterdrückung und Hassreden regeln.

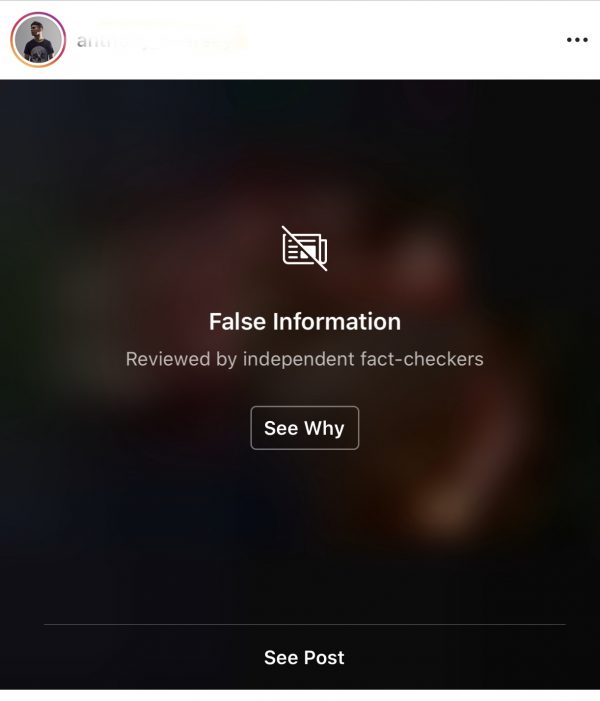

Videos, bei denen die Sachlage nicht ganz eindeutig ist, werden von einem unabhängigen Drittanbieter überprüft, zu denen über 50 Partner weltweit gehören, die de Facto in über 40 Sprachen überprüfen können. Wenn ein Foto oder Video von einem Fact-Checker als gefälscht oder teilweise gefälscht eingestuft wird, wird dieses von Facebook mit einer erheblich eingeschränkten Verbreitung im News Feed abgemahnt und im Fall einer Werbeanzeige gänzlich abgelehnt. Das ist aber noch nicht alles. Statt die Inhalte von der Plattform zu nehmen, werden diese nun mit einer Warnung versehen, die darauf hinweisen, dass es sich hierbei um gefälschte Inhalte handelt.

Warnung für gefälschte Inhalte (Quelle: Instagram)

Facebook entscheidet sich bewusst dagegen, Inhalte ohne Weiteres zu entfernen. Denn es gibt keine Garantie, dass Videos, die von Prüfinstanzen als “fake” gekennzeichnet wurden, nicht auch noch an anderer Stelle im Internet oder im Social Media Ökosystem verfügbar sind. Indem sie auf den Plattform bestehen bleiben und als falsch gekennzeichnet werden, kann sichergestellt werden, dass die User entsprechend über den Wahrheitsgehalt der Botschaft aufgeklärt sind und Informationen und Kontext erhalten.

Weiterhin soll die neue Richtlinie dazu dienen, die Täter hinter den Fake-Videos aufzuspüren und zu entlarven.

Zudem kündigt Facebook im Kampf gegen Deep Fakes und manipulierten Inhalten weitere Aktivitäten wie die “Deep Fake Detection Challenge” an, die im vergangenen Herbst ins Leben gerufen wurde. Laut Facebook soll sie dazu dienen “mehr Forschung und Open-Source-Werkzeuge zur Erkennung von Deep Fakes zu produzieren”.

Zusätzlich kooperiert Facebook mit der Nachrichtenagentur Reuters, um kostenlose Online-Trainingskurse für Journalisten anzubieten, die Reportern dabei helfen sollen, manipulierte Bilder und Videos besser zu identifizieren.

Wie sinnvoll die aktualisierte Richtlinie tatsächlich ist, wird sich noch zeigen. Die doch eher schmal definierten Kriterien bzw. Punkte zu Parodie, Satire und eine veränderte Wortwahl, die im Rahmen der Überprüfung aussen vor gelassen werden, lassen aktuell noch einiges an Interpretationsspielraum zu und die den tatsächlich beabsichtigten Effekt, nämlich die klare und eindeutige Identifizierung von gefälschten Inhalten und Fake News anhand diverser Beispiele aus der Politik deutlich in Frage stellen. Es kann also davon ausgegangen werden, dass “Deep Fake Creators” auch in Zukunft ihre Grenzen testen werden, um entsprechende Schlupflöcher zu finden.